Haben wir mit unseren Blogs in einer Zeit, in der immer mehr über KI gesucht wird, überhaupt noch eine Chance, gefunden zu werden? Die kurze Antwort: immer seltener direkt – aber möglicherweise häufiger indirekt. Immer mehr Menschen fragen ChatGPT, Perplexity oder Gemini und bekommen sofort eine fertige Antwort. Keine Liste von Links mehr, sondern einen zusammenhängenden Text, der das Gefühl gibt, es sei alles beantwortet.

Was also tun, damit uns Leserinnen und Leser doch noch finden? GEO – Generative Engine Optimization heißt das neue Zauberwort. Genau darüber diskutieren Lars Basche und ich in unserem Podcast #9vor9.

Warum verlieren Blogs bei Google seit Jahren an Sichtbarkeit?

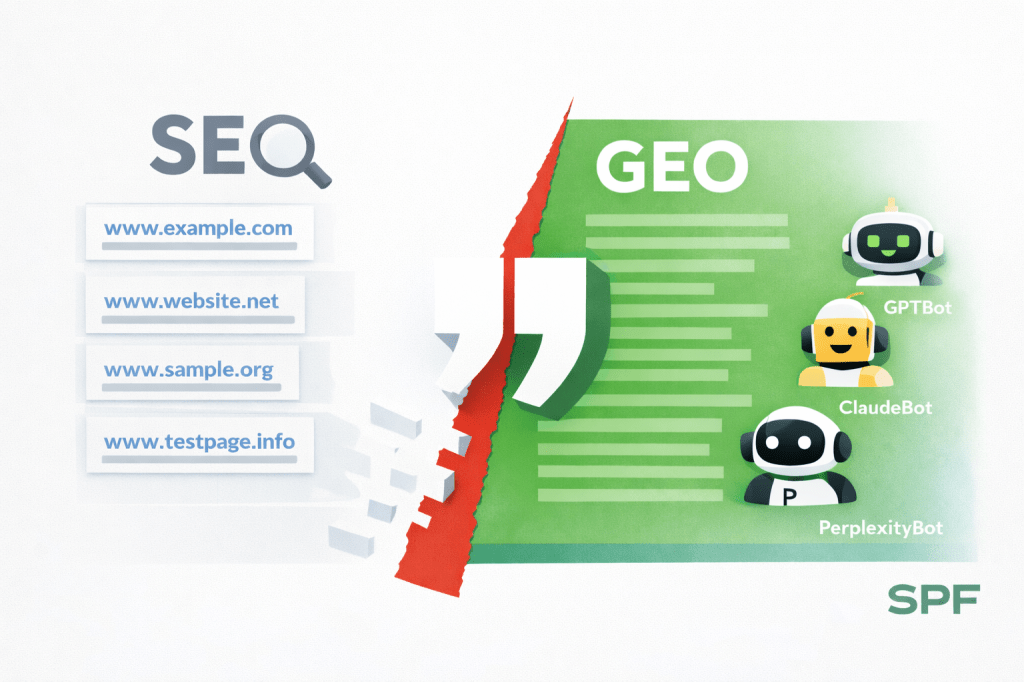

Ist der Wandel größer, als er auf den ersten Blick wirkt? Jahrzehntelang ging es im Netz darum, bei Google möglichst weit oben zu stehen. SEO – Search Engine Optimization – war die Disziplin, die über Sichtbarkeit entschied. Also eigentlich, denn irgendwann drehte Google uns Bloggerinnen und Bloggern den Saft ab. Seit etwa 2018–2020 hat Google Blogs in den Suchergebnissen deutlich weniger stark berücksichtigt.

Ausschlaggebend waren vor allem zwei große Algorithmus-Updates, mit denen Google gezielt „nicht hilfreiche“ oder rein SEO-optimierte Blogartikel herausfilterte, woraufhin selbst große Blogs wie HubSpot bis zu 40 % ihres Traffics verloren, während im Gegenzug Corporate-Websites und etablierte Medien bevorzugt wurden.

Warum klicken Nutzer nach einer KI-Antwort immer seltener auf Webseiten?

Nun erleben wir also einen Paradigmenwechsel. Unsere Inhalte sollen nicht nur von Suchmaschinen gefunden werden, sondern möglichst von KI-Antwortmaschinen zitiert werden. Die klassische Weblogik war simpel:

Suchmaschine → Linkliste → Klick → Website.

KI-Suche verändert diese Kette fundamental. Statt einer Liste von Links liefert die KI sofort eine Antwort. Für Nutzerinnen und Nutzer ist das komfortabel. Denn viele Menschen bleiben einfach bei der Zusammenfassung der KI stehen und klicken gar nicht mehr auf die ursprünglichen Quellen.

Lars bringt es auf den Punkt: In seinem privaten Umfeld nutzen viele Menschen inzwischen ganz selbstverständlich KI-Tools für ihre Recherche. Die klassische Google-Suche verliert an Bedeutung. Zwar verweilen Besucher, die über ChatGPT auf eine Website kommen, deutlich länger auf der Seite. Das Problem ist nur: Sie kommen viel seltener überhaupt dort an.

Sollten Blogger KI-Bots blockieren – oder bewusst zulassen?

Was sollten oder müssen wir also tun, damit überhaupt die Chance besteht, dass uns die KI-Antwortmaschinen finden? Zuerst einmal müssen wir uns entscheiden, ob wir das überhaupt wollen. Wer ChatGPT, Gemini und Co. nicht mit seinen Inhalten füttern will, der kann sie aussperren. Der Schlüssel ist hierbei die Datei robots.txt. Genau dort legen Webseitenbetreiber normalerweise fest, welche Bots ihre Inhalte durchsuchen oder für KI-Training nutzen dürfen. Zum Thema unten mehr.

Was bedeutet Generative Engine Optimization (GEO)?

GEO beschreibt Strategien, mit denen Inhalte so strukturiert werden, dass KI-Systeme sie erkennen, verstehen und zitieren können. Erinnern wir uns: Zitate sind die neue Währung. Im Zeitalter von ChatGPT & Co. ist nicht mehr nur der Klick entscheidend, sondern das Zitat in der KI-Antwort. Oder wie wir es im Podcast sagen.

Bei GEO kommt es mehr darauf an, dass du zitiert wirst … damit deine Marke präsent ist.

Lars ergänzt dazu aus der Praxis seiner Agentur: Für Unternehmen wird inzwischen zunehmend untersucht, wie oft Marken in KI-Antworten auftauchen – eine Art neue „AI Visibility“.

Wie schreibt Ihr für KI-Bots? 3 GEO-Regeln

Und was sind aber die Spielregeln, damit Euer Blog (oder eure Webseite) gefunden wird?

1. Beginnt mit einer Frage – und beantwortet sie sofort.

KI-Systeme bevorzugen Inhalte, die konkrete Nutzerfragen aufgreifen. Also nicht „Bürokratieabbau in Deutschland“ schlecht ❌. Stattdessen: „Wie senke ich die Bürokratiekosten meines Vereins um 25 % – und welche Tools helfen dabei?“ besser ✅!

Warum funktioniert das: KI-Bots scannen nach Frage-Antwort-Strukturen. Wer diese liefert, wird eher zitiert.

2. Fakten, Daten, Quellen: Warum KI-Systeme auf „Trust-Signale“ achten.

KI-Plattformen bewerten Inhalte nach dem sogenannten EEAT-Prinzip (Experience, Expertise, Authoritativeness, Trust). Außerdem Statistiken einbauen (z. B. „Laut einer Studie der Uni München (2025) sparen 67 % der Mittelständler durch Digitalisierung Zeit“), auf seriöse Quellen verlinken (Wikipedia, Fachmedien, offizielle Studien) und euer Autorinnen- und Autoren-Profil sichtbar machen (Wer steht hinter dem Text? Welche Expertise habt Ihr?).

Ein Beispiel aus der Praxis:

„Eine aktuelle Erhebung des Digitalverbands Bitkom (2026) zeigt: 78 % der Nutzer:innen vertrauen KI-Antworten mehr, wenn sie mit klaren Quellen belegt sind.“

3. Maschinenlesbarkeit: Warum die Struktur Eures Artikel wichtig ist

KI-Bots lesen nicht – sie scannen. Deshalb sind kurze Absätze (max. 3–4 Sätze) ebenso wichtig wie klare Zwischenüberschriften, am besten in Frageform. „TL;DR“-Zusammenfassungen am Anfang sind wohl effektiv. Das steht für Too long; Don’t read und fordert, dass man die Kernaussage kurz zusammenfasst. Komplexe Infos soll man in Bullet Points aufbauen, da KI-Systeme daraus leichter Zitate extrahieren können.

Welche Inhalte bevorzugen KI-Systeme wie ChatGPT, Perplexity oder Google?

Doch gibt es auch Unterschiede zwischen den verschiedenen Antwortmaschinen. Die verschiedenen Systeme bevorzugen offenbar unterschiedliche Quellen. Studien zeigen beispielsweise, dass ChatGPT häufig Wikipedia und große Medien nutzt, Perplexity stärker auf Foren und Blogs zurückgreift und Google stark Inhalte aus YouTube nutzt. Wen wundert es? Die Informationslandschaft der KI ist nicht neutral. Sie wird geprägt durch Plattformen, Datenzugänge und wirtschaftliche Interessen. Man könnte auch sagen: Die Macht der Plattformen wächst weiter.

„Don’t schwafel“

Was man nicht tun soll und was uns bei unserem Podcast #9vor9 zum GEO-Verhängnis wird: „Geschwafel“! Ironische Einleitungen, lange Vorreden und Witzeleien werden von KI-Bots ignoriert – oder sogar als „nicht relevant“ eingestuft. Struktur schlägt Geschwafel. Zumindest bei den Antwortmaschinen. Aber Gefrotzele macht halt auch Spaß. Tja, da haben wir wohl Pech gehabt.

Wird GEO SEO wirklich ersetzen?

Nein. SEO bleibt wichtig für klassische Suchmaschinen. GEO ergänzt SEO und entscheidet zunehmend darüber, ob Inhalte in KI-Antworten erscheinen. GEO baut auf den Basics von Search Engine Optimization auf und bleibt wichtig für klassische Suchmaschinen (Google, Bing). GEO beeinflusst, ob Ihr von KI-Systemen zitiert werdet.

Was sind die SEO- und GEO Prioritäten für 2026?

| Maßnahme | SEO-Relevanz | GEO-Relevanz | Aufwand |

|---|---|---|---|

| Frage-basierte Überschriften | Mittel | Hoch | Gering |

| EEAT-Optimierung (Quellen, Autor:innen-Profil) | Hoch | Sehr hoch | Mittel |

| Kurze Absätze + TL;DR-Zusammenfassungen | Gering | Hoch | Gering |

| Backlinks aufbauen | Hoch | Mittel | Hoch |

| KI-spezifische Keywords (z. B. „Wie…?“, „Tipps für…“) | Mittel | Hoch | Gering |

Wir müssen GEO auf jeden Fall im Blick behalten, denn die KI-Suche wächst dreimal schneller als klassische Suchanfragen, aber …

Schreiben für Menschen – nicht für Bots

Am Ende unseres Gesprächs kommen wir zurück zu den „Essentials“. Mögen Unternehmen und Medien über neue KPIs und Sichtbarkeit diskutieren. Was habe ich in meiner Ausbildung als Journalist (hoffentlich) gelernt und verinnerlicht?

Einfach vernünftig schreiben, gut lesbar schreiben, gut strukturieren.

Und Lars bringt es zum Schluss noch einmal auf den Punkt:

Für Menschen schreiben und nicht für Bots.

Vielleicht ist das tatsächlich die wichtigste Erkenntnis aus unserer Diskussion. Die Suchmaschinen mögen sich verändern. Die Plattformen auch. Aber gute Texte entstehen immer noch dort, wo Menschen Gedanken entwickeln, sie aufschreiben und veröffentlichen, auch mit Hilfe von KI. Am Ende zählt nicht, ob eine KI euren Text liest – sondern ob ein Mensch ihn versteht… und weiterempfiehlt. Und irgendwo wird eine KI sie später lesen. Vielleicht.

Eure Meinung zu GEO?

- Blockiert Ihr KI-Bots – oder optimiert Ihr für sie?

- Habt Ihr schon Erfahrungen mit GEO gemacht?

GEO vs. SEO: Wie KI-Suchmaschinen das Web verändern – #9vor9 – Die Digitalthemen der Woche

Die Folien zum Podcast – erstellt nach unseren Vorgaben von NotebookLM

Nachwort: Mehr zu robots.txt

Viele Medienhäuser blockieren inzwischen gezielt Crawler wie GPTBot (OpenAI), ClaudeBot (Anthropic), PerplexityBot (Perplexity) oder Google Extended (Google), damit Leserinnen und Leser weiter auf ihre Webseiten kommen – und nicht bei ChatGPT einfach hängenbleiben. Nun kann man durchaus kontrovers diskutieren, ob das sinnvoll ist oder ob man Lösungen mit KI-Antwortmaschinen-Anbietern finden sollte, um von diesen Gebühren zu kassieren.

Natürlich habe ich in Vorbereitung unseres Podcasts gleich mal geschaut, ob ich robots.txt bearbeiten kann und meine Befürchtung hat sich bewahrheitet: Wer wie ich seinen Blog auf der gehosteten Plattform WordPress.com betreibt, hat schlicht keinen Einfluss auf die Datei. Denn WordPress.com erzeugt die robots.txt automatisch – individuelle Regeln lassen sich nicht eintragen. Das geht erst ab dem Business-Tarif, der teurer ist. Ich nutze lediglich den Premium-Tarif.

Damit fehlt mir die Möglichkeit, einzelne KI-Bots auszuschließen, ohne gleich die gesamte Seite für Suchmaschinen unsichtbar zu machen. Das Problem betrifft nicht nur WordPress.com. Auch Plattformen wie Substack, Medium oder viele Baukastensysteme lassen ihren Nutzern oft nur begrenzte Kontrolle darüber, welche Bots Inhalte crawlen dürfen. Mein Blog ist also für die KI-Antwortmaschinen auffindbar. Zumindest theoretisch. Damit ich aber zitiert werde, muss ich noch einiges tun.

Kommentar verfassen