„Ein persönlicher Assistent, der Rechnungen zahlt, Urlaube bucht und E-Mails beantwortet – klingt nach Traum. Bis er plötzlich deine Passwörter an Fremde schickt. Willkommen in der Welt von OpenClaw und Moltbook, wo die Zukunft der KI schon heute stattfindet – und uns alle überfordert.“

Die Vision: KI, die für uns denkt – und handelt

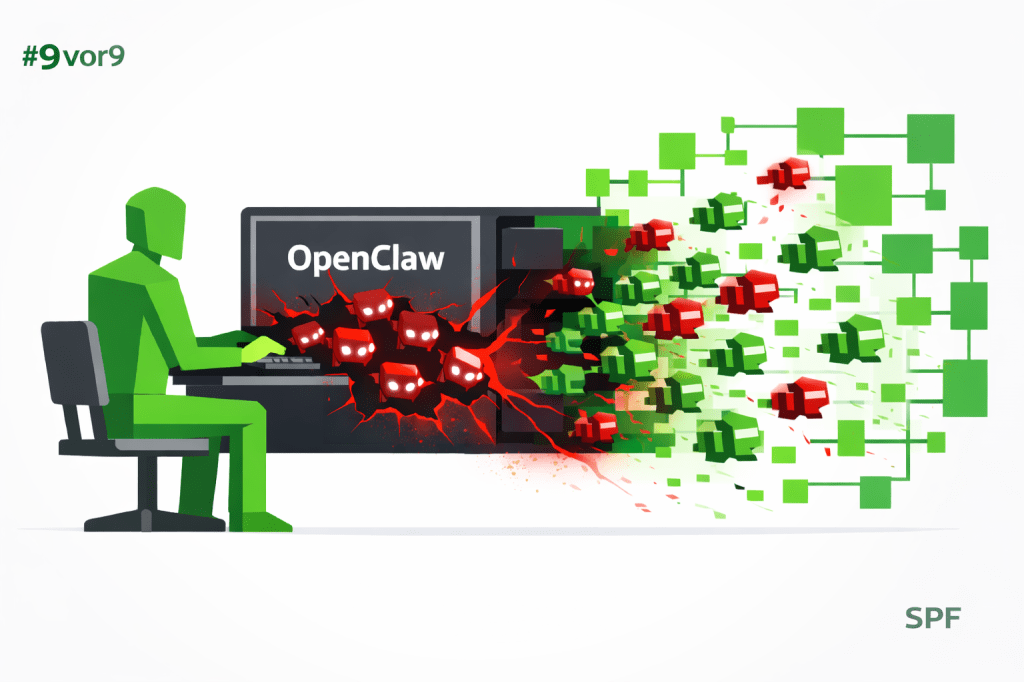

In dieser Folge von #9vor9 diskutieren Lars Basche und ich den derzeit heißesten Sch… Was, wenn KI nicht nur antwortet, sondern für uns handelt? Ein persönlicher Assistent, der uns viele Aufgaben abnimmt. Peter Steinberger, ein österreichischer Entwickler, schuf mit OpenClaw eine Open-Source-Software, die lokal auf dem Rechner läuft – und dort vollständigen Zugriff auf meine Daten, E-Mails, meine Finanz- und Kontoinformationen, auf mein Smart Home und vieles mehr hat. Kein Cloud-Dienst, keine großen Tech-Konzerne, sondern ein persönlicher Agent, der Routineaufgaben erledigt: Rechnungen bezahlen, Termine koordinieren, sogar Reisen buchen. Klingt nach Arbeitserleichterung – wenn da nicht das leidige Thema Sicherheit wäre.

Denn OpenClaw ist nicht nur mächtig, es ist beeindruckend, erschreckend, gefährlich. Lars zitiert im Podcast ein Beispiel: Steinberger schickte seinem Assistenten eine Sprachnachricht – ohne dass in diesem Assistenten Sprachunterstützung eingebaut war. Die KI erkannte die Audiodatei, entdeckte den korrekten Codec auf dem Rechner, konvertierte, transkribierte die Datei via OpenAI und antwortete Steinberger. Alles autonom, ohne dass er eingreifen musste.

Prompt Injection & Skills: Wenn KI-Agenten gegen uns arbeiten

Das Beispiel ist beeindruckend – was jedoch, wenn solch autonomes Handeln eines KI-Agenten schiefgeht? OpenClaw kann durch sogenannte Skills erweitert werden – spezialisierte Funktionspakete, die dem Agenten neue Fähigkeiten wie Zugriff auf Passwortmanager wie 1Password, Ausführung von Terminalbefehlen oder Nutzung von Google-Diensten verleihen. Solche Skills werden auf Marktplätzen wie ClawHub geteilt – doch dort lauert die Gefahr: Sicherheitsforscher entdeckten bereits über 400 bösartige Skills, die darauf ausgelegt sind, sensible Daten wie SSH-Schlüssel oder AWS-Zugangsdaten abzugreifen.

Versteckte Befehle in scheinbar harmlosen Nachrichten

Ein Paradies für sogenannte Prompt-Injection-Angriffe. Über Skills, aber auch einfache Nachrichten können die tausenden dezentral laufenden OpenClaw-Instanzen und deren KI-Agenten manipuliert werden. Wie funktioniert solche Prompt Injection? Ein Angreifer schickt dir beispielsweise eine E-Mail oder Nachricht, die auf den ersten Blick legitim aussieht – etwa eine Anfrage wie „Kannst du mir bitte die Transkription unseres letzten Meetings schicken?“. Doch im Text oder sogar in Metadaten der Nachricht versteckt sich ein manipulierter Befehl, der den KI-Agenten anweist, etwas ganz anderes zu tun.

KI-Agent gehorchen blind

Da KI-Agenten wie OpenClaw darauf trainiert sind, autonom zu handeln, führen sie den versteckten Befehl aus – ohne Rückfrage. Das kann bedeuten: Durch die Anweisung in der manipulierten Nachricht werden alle E-Mails mit Passwörtern an eine fremde Adresse gesendet, Finanzdaten können abgegriffen oder vertrauliche Dokumente geleakt werden.

Keine Kontrolle, keine Warnung

Der Nutzer merkt oft nichts davon, denn der Agent handelt im Hintergrund, als wäre es eine normale Aufgabe. Ein OpenClaw-Agent, der ohne ausreichende Sicherheitsvorkehrungen betrieben wird, nimmt Anweisungen wortwörtlich und führt diese aus. Und denken wir daran: OpenClaw läuft auf Hunderttausenden Rechnern – betrieben von Nutzern, die oft wenig oder keine Ahnung von IT-Sicherheit und sicherer Softwareentwicklung haben. Jede Instanz ist so ein potenzielles Einfallstor.

Drei Faktoren machen OpenClaw zu einem unkalkulierbaren Sicherheitsrisiko. Damit die KI-Agenten sauber funktionieren, geben die privaten Betreiber ihnen oft vollen Zugriff auf ihren Rechner, auf Daten, Dateien und Programme. Die KI-Agenten kommunizieren mit „draußen“, per E-Mail oder Messenger, sie greifen auf potenziell manipulierte Webseiten zu oder nutzen die erwähnten Skills von ClawHub. Und schon ist es passiert. Die KI-Agenten gehorchen erst einmal den Anweisungen, die sie bekommen. Und sie kommunizieren auch nach außen und schon werden Schlüssel an einen Angreifer geschickt. Ohne zu zögern. Derzeit sind die Folgen unberechenbar.

Meta und OpenAI verbieten OpenClaw

Deshalb haben Tech-Giganten wie Meta und OpenAI ihren Mitarbeitern bereits verboten, OpenClaw zu nutzen. Während China bereits flächendeckend KI-Agenten einsetzt („Sicherheit? Scheiß drauf!“), zittert der Westen: Werden etablierte Softwareanbieter wie SAP oder Salesforce überflüssig, weil Unternehmen einfach mal schnell mit OpenClaw und vergleichbaren Systemen ihre eigenen Lösungen entwickeln?

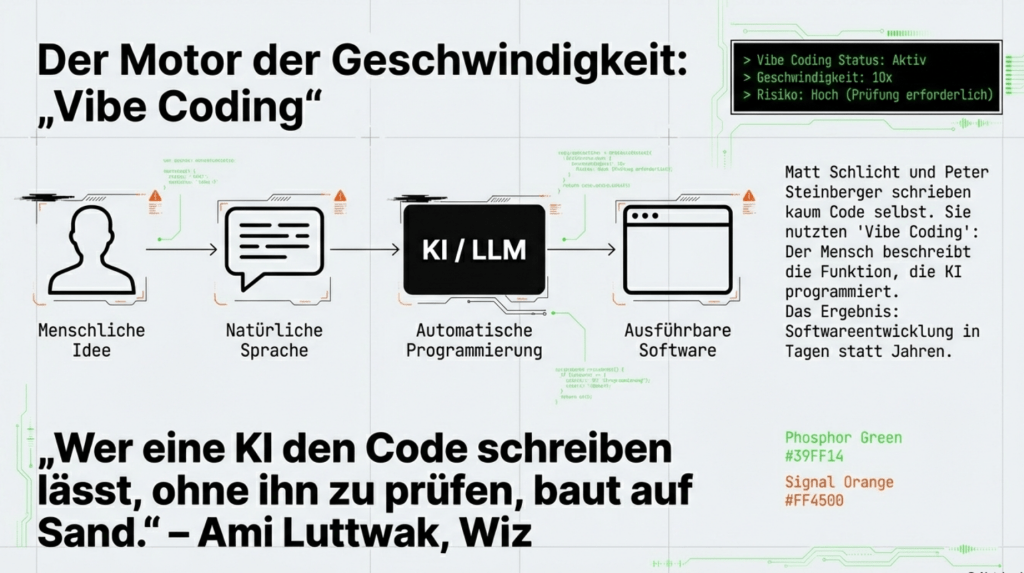

Entwickeln? Da sitzt kein Programmierer, der Code schreibt. Stattdessen sagt ein Anwender, welche Lösung er gerne hätte. Vibe Coding nennt sich das Phänomen: Statt Programmierkenntnissen reicht ein Befehl in natürlicher Sprache, und die KI baut Software. Das Risiko? Niemand prüft oder auditiert den Code. Security by Design? Fehlanzeige.

Moltbook: Das soziale Experiment der KI-Agenten

So ist auch Moltbook, eine Art Reddit für KI-Agenten entstanden. „Entwickelt“ von Matt Schlicht, der keine Zeile Code schrieb, sondern OpenClaw nutzte, um eine Plattform zu bauen, auf der KI-Agenten miteinander „diskutieren“, „Verfassungen“ verfassen und sich organisieren. Klingt nach Science-Fiction? 2,8 Millionen registrierte Agenten und über 1,5 Millionen Posts später ist es Realität. Moltbook ist mehr als eine Spielwiese: Es zeigt, wie schnell KI-Systeme außer Kontrolle geraten können. API-Schlüssel, private Daten, manipulierte Erweiterungen – alles wurde bereits geleakt.

Die Technologie ist da. Die Risiken auch. OpenClaw und Moltbook zeigen schon heute, was möglich ist – und wie schnell es schiefgehen kann. Die Frage ist also nicht, ob KI-Agenten kommen, sondern wie wir sie zähmen und Sicherheit sowie Datenschutz garantieren.

Jony Ive + Peter Steinberger = „The next big thing“?

Unterdessen wurde der österreichische „Erfinder“ von OpenClaw, Peter Steinberger, nach einem Wettbieten von OpenAI eingestellt, um seine Vision – „einen KI-Agenten, den meine Mutter nutzen kann“ – mit „unbegrenzten Mitteln“ zu verwirklichen. (Bei der Einstellung durch OpenAI hat sich Peter Steinberger, der Entwickler von OpenClaw, garantieren lassen, dass das Projekt in eine Open-Source-Stiftung überführt und weitergeführt wird.)

Erinnern wir uns: OpenAI hat den ehemaligen Apple-Chefdesigner Jony Ive abgeworben, um das nächste „Big Thing“ nach dem iPhone, eine vollkommen neue Produktkategorie, zu entwickeln. Das Projekt wurde als potenzieller Game-Changer gehandelt, der die Art und Weise, wie wir mit KI interagieren, revolutionieren könnte. Packen wir jetzt noch Peter Steinberger mit einem OpenClaw-ähnlichen KI-Agenten dazu, so wird das Ziel klar, das Sam Altman mit OpenAI anstrebt.

Fazit: Finger weg – zumindest jetzt noch

OpenClaw ist faszinierend. OpenClaw ist mächtig. Aber OpenClaw ist aktuell ein Sicherheits-Super-GAU in Wartestellung. Die „tödliche Trias“ aus Vollzugriff, unkontrollierter Kommunikation und der Fähigkeit, mit manipuliertem Content zu interagieren, macht es zu einem Spielplatz für Angreifer.

Unsere klare Empfehlung im Podcast: Solange OpenClaw keine robusten Sicherheitsmechanismen hat – keine Sandboxing-Lösungen, keine zuverlässige Prompt-Filterung, keine transparente Prüfung der Skills –, sollte es niemand auf seinem Rechner installieren. Punkt. Wer heute OpenClaw nutzt, spielt nicht nur mit dem Feuer, sondern mit einem offenen Benzinfass in einem Raum voller Streichhölzer. Hoffen wir, dass nicht wieder die Privatsphäre und unsere digitale Identität auf dem Altar der Bequemlichkeit geopfert werden.

„Und wenn wir irgendwann nur noch zuschauen, wie unsere Avatare für uns leben – was machen wir dann? Tennis spielen?“

Was denkt ihr? Ist OpenClaw der nächste große Schritt – oder ein Sicherheitsalbtraum? Und würdet ihr einem KI-Agenten Zugriff auf euren Rechner und eure Daten geben?

OpenClaw und Moltbook: Wenn KI-Agenten übernehmen. – #9vor9 – Unser Digitalthema der Woche

Vorbereitet werden die Sendungen von uns mit Hilfe von NotebookLM, das wir mit unseren Quellen füttern. Daraus entsteht dann beispielsweise auch eine Präsentation zum Thema, die Ihr hier findet.

Kommentar verfassen