Eine Freundin von uns hat Knie – um es mit Horst Schlämmer zu sagen. Nein, die Angelegenheit ist nicht zum Lachen. Sie wurde auf Anraten eines Arztes operiert und diese OP hat nichts gebracht. Der nächste Arzt dann: Das hätte ich ihnen gleich sagen können. Das Problem ist noch immer nicht gelöst. Sie humpelt die Treppen in ihrer Wohnung hoch. Ein unerträglicher Zustand. Nun soll eine weitere OP helfen, ein künstliches Kniegelenk. Ich drücke ihr alle Daumen.

Warum diese Einleitung? Sie hat uns dann erzählt, dass sie ChatGPT nach ihren Symptomen und allem drum herum befragt hat. Und sie hatte das Gefühl, dass ihr die Künstliche Intelligenz (das dahinter liegende Large Language Model) die weitaus besseren Informationen geliefert hat, als es die verschiedenen ach so kompetenten und spezialisierten Ärzte getan haben.

Ein halluzinierender KI-Doktor

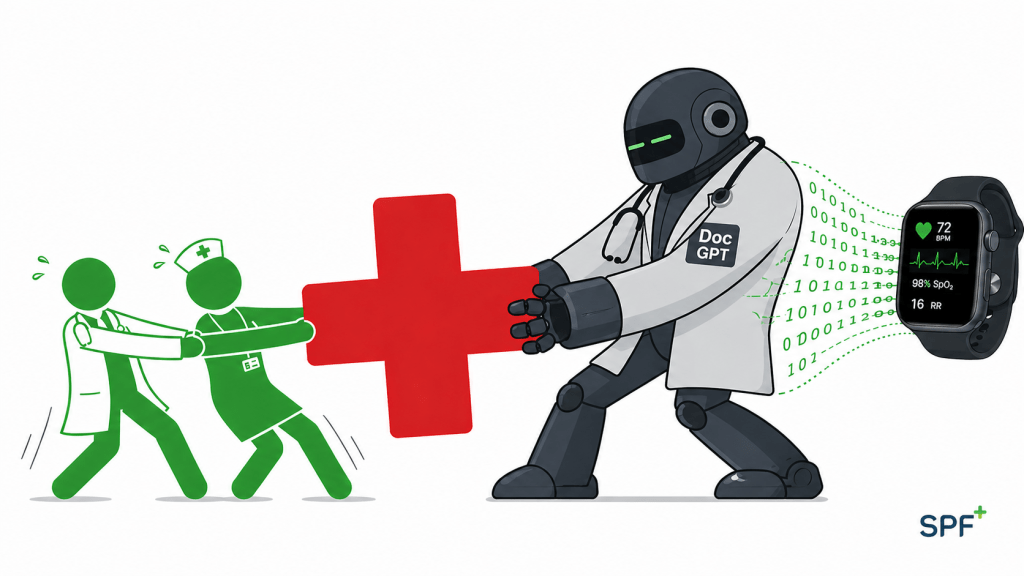

Ich habe das bisher unserer Freundin gegenüber nicht kommentiert, aber mich überkommt eine Woge der Skepsis. Dass Ärzte Doktor Google nicht mögen, ist allgemein bekannt. Nun kommt Doc ChatGPT um die Ecke, ist noch deutlich eloquenter und erklärt absolut selbstsicher, was welche Beschwerden bedeuten und wie man sie behandeln sollte. Gewogene Leserinnen und Leser dieses Blogs ahnen schon, auf was ich hinaus will: ChatGPT, Gemini, Claude, Perplexity, all diese so tollen Systeme der künstlicher Intelligenz halluzinieren regelmäßig.

Dabei klingt “halluzinieren” so harmlos. Sie liefern falsche Informationen, sie lügen. Und darauf soll man in Gesundheitsfragen vertrauen? Dann schaue ich auf meinen Arm, an dem seit vielen Jahren eine Apple Watch prangt. Es ist unterdessen die vierte Apple Watch und sie kann immer mehr. Vor zehn Jahren habe ich mein erstes Apple-Watch-Tagebuch geschrieben. Damals war die Uhr für mich vor allem eines: ein Fitnesstracker, der zählte, ob ich genug gelaufen, gestanden, trainiert habe.

„Don’t break the chain” — das Motto habe ich von Volker übernommen und seither, mit ein paar krankheits- und feiertagsbedingten Ausrutschern, durchgehalten. Heute trage ich immer noch eine Apple Watch am Handgelenk, aber die zählt nicht mehr nur Schritte. Sie misst die Herzfrequenz, schreibt ein EKG, warnt vor Vorhofflimmern, erkennt Stürze, registriert Schlafphasen und Sauerstoffsättigung. Aus dem Schrittzähler ist ein kleines gesundheitliches Frühwarnsystem geworden.

Die Apple Watch als Schutzengel

Volker, der erwähnte Journalist aus Darmstadt, hat seine Geschichte erzählt: Er stellte beim Blick auf seine Apple Watch fest, dass sein Herz unter Stress war. Ab ins Krankenaus. Hausarzt, Internist und Chirurg empfahlen binnen zwei Stunden eine Intervention, vier Tage später wurde er aus dem Krankenhaus entlassen, eine schwere Sepsis überwunden. Solche Fälle sind keine Einzelphänomene mehr. Studien zeigen, dass Smartwatches Vorhofflimmern im Alltag häufig entdecken — gerade bei älteren Menschen. Wer schon einmal einen schiefen Herzrhythmus gespürt hat oder jemanden kennt, der einen Schlaganfall wegen unerkannten Vorhofflimmerns erlitten hat, weiß: Das ist keine Spielerei. Das ist extrem ernst und hilfreich.

Doch erscheinen die Gesundheitsfunktionen der Apple Watch eigentlich nur als Spielerei angesichts dessen, was nun auf uns zurollt. Anfang 2026 betritt ein neuer Akteur das Spielfeld: ChatGPT Health, in den USA gerade gestartet, in Europa wegen Datenschutz noch nicht verfügbar. OpenAI verspricht, die Daten aus Apple Health, MyFitnessPal, Patientenakten und Laborwerten in der KI zusammenzuführen, Trends zu erklären, auf Arzttermine vorzubereiten.

Das ist die nächste Evolutionsstufe. Es wird nicht mehr nur das generelle Modell von ChatGPT befragt. In ChatGPT Health kommen eigene Daten hinzu, um auf dieser Basis gezielter Fragen beantworten zu können. Vom Schrittzähler am Handgelenk zum KI-basierten Gesundheitscoach — das ist das Versprechen. Und ich bin überzeugt, nicht nur OpenAI wird auf diesen Zug aufspringen.

Wenn der Schutzengel zur Angstmaschine wird

Doch es gibt auch Schattenseiten. Beratungsstellen und Erfahrungsberichte beschreiben Menschen, die wegen wiederholter Herz-Alerts dutzende Arztbesuche absolviert oder hunderte EKGs auf der Uhr aufgezeichnet haben — ohne klinisch relevanten Befund, dafür mit zunehmender Angst. DocCheck hat das Phänomen sauber beschrieben: Eine Uhr, die jeden kleinen Ausschlag als möglicherweise gefährlich meldet, ist für jemanden mit Tendenz zur Gesundheitsangst kein Schutzengel, sondern ein permanenter Trigger. Cyberchondrie heißt das, was früher „Doktor Google” hieß.

Von Doktor Google zu Doc ChatGPT

Doktor Google war eine Suchmaschine, die einem Treffer aufzählte, Links, hinter denen sich harmlose bis dramatische Informationen befanden. Doc ChatGPT formuliert hingegen verständlich, „spricht“ ganz persönlich mit mir. Doch eine Studie der Universität Oxford, vom SRF zusammengefasst, kommt zu einem ernüchternden Ergebnis: Wer seine Symptome einer KI schildert, bekommt nur in einem Drittel der Fälle die richtige Diagnose und nur in 44 Prozent der Fälle eine richtige Handlungsempfehlung.

Auch jenseits der Diagnosegüte stellt sich die alte, aber drängende Frage: Was geschieht eigentlich mit meinen Gesundheitsdaten? OpenAI betont starke Verschlüsselung, isolierte Speicherbereiche, separate Schutzmaßnahmen für Health-Gespräche, die nicht ins generische Training des Large Language Model fließen dürfen. Trotzdem: Wenn Apple-Health-Daten, Laborwerte, Wearable-Streams und Chatverläufe in einem proprietären US-System zusammenlaufen, entsteht ein Datenpool, vor dem uns mulmig werden sollte. Wollen wir wirklich sensibelste Gesundheitsdaten mit profitgetriebenen Unternehmen teilen, die dringend Kohle machen müssen?

Zwischen Heilsversprechen und Realitätscheck

Mein Zwischenfazit nach zehn Jahren Apple Watch und ein paar Wochen Lektüre über ChatGPT Health: Diese Systeme sind weder Heilsbringer noch Teufelszeug. Eine Uhr, die früh auf Vorhofflimmern hinweist, und Volker rechtzeitig ins Krankenhaus bringt, ist ein echter Gewinn. Ein Chatbot, der Laborwerte „übersetzt“ und auf den nächsten Arzttermin vorbereitet, das macht Sinn. Endlich jemand, der mir medizinische Sachverhalte verständlich erklärt, das wäre doch ein Träumchen. Doch ChatGPT Health sollte nicht so tun, als sei es Diagnostiker. Beide Werkzeuge taugen als Frühwarn- und Reflexionsinstrument, nicht als Ersatz für den Arzt oder die Ärztin.

Für uns als Gesellschaft heißt es: Wir sollten nicht nur darüber reden, wie viele Leben Apple oder OpenAI „retten” — sondern auch darüber, welche Regeln, Infrastrukturen und europäischen Antworten wir brauchen, damit diese neue Schicht des Gesundheitssystems nicht allein von Profit, Marktlogiken, Plattformökonomie und Datenhunger geprägt wird. Sonst tauschen wir am Ende nur Doktor Google gegen Doc ChatGPT — und das wäre kein Fortschritt.

War da nicht noch was? Ach ja, in Deutschland steht eine Gesundheitsreform an.

Quellen & Leseempfehlungen

- Mein Apple Watch Tagebuch (2015) — StefanPfeiffer.Blog

- Apple Watch mit HealthFit auswerten #Dontbreakthechain — StefanPfeiffer.Blog

- Datenschutz bei Apple — StefanPfeiffer.Blog

- KURATIERT: Aleph Alpha, Apple, Microsoft, Doc Sam — StefanPfeiffer.Blog

- Volker Weber: Wie Apples Smartwatch vom Flop zum Klassiker wurde (Spiegel-Bezug)

- ChatGPT Gesundheit — OpenAI

- «Doktor ChatGPT»: Warum man der KI nicht vertrauen sollte — SRF

- Cyberchondrie ist gefährlich — Pharmazeutische Zeitung

- Kann die Apple Watch Vorhofflimmern erkennen? — DocCheck

- ChatGPT Health: So analysiert KI eure Gesundheitsdaten – Jörg Schieb

Kommentar verfassen