Ende 2011 habe ich hier im Blog über Siri und KI-Systeme für Unternehmen geschrieben: Nach Tastatur, Maus und Touchscreen wird Sprache das nächste natürliche Interface sein — für den Computer, fürs iPhone, fürs SmartHome. „Alles nur eine Frage der Zeit.“ Das war vor fünfzehn Jahren. Lange Zeit sah es nicht danach aus. Siri blieb der Wetterfrosch, Alexa der Einkaufsknopf, der Google Assistant der Timer-Steller. Die entsprechenden Geräte und smarten Lautsprecher habe ich 2018 als trojanisches Pferd in unseren Wohnzimmern beschrieben, weil sie viel zu wenig konnten und gleichzeitig viel zu viel abhörten. Diese Gefahr besteht übrigens noch immer.

Aber jetzt scheint der Moment gekommen, in dem das lange angekündigte Versprechen plötzlich wahr werden könnte. Wir tippen oder sprechen in natürlichen Sätzen mit unseren Geräten. Genauer: Large Language Models auf unseren Devices verstehen uns — endlich. Jörg Schieb bringt es in seinem Kommentar zu Claude Design auf den Punkt: „Wir erleben gerade, wie Textbeschreibung zur neuen Universalsprache für Produktion wird. Erst Code (Claude Code), dann Dokumente (Claude.ai), jetzt Design (Claude Design). Der Trend ist eindeutig: Du beschreibst, KI baut.“ Das ist ein bahnbrechender Paradigmenwechsel.

Vom Kommando zum Dialog — warum Siri den Durchbruch verpasst hat

Der Unterschied zu den Sprachassistenten der 2010er Jahre ist technisch, aber seine Folgen sind kulturell. Siri, Alexa und der Google Assistant waren Kommandoparser: Sie bildeten natürliche Sprache auf ein enges Set vordefinierter Funktionen ab. Sagte man etwas Unerwartetes, hieß es „Das habe ich leider nicht verstanden“.

Large Language Models, große Sprachmodelle wie die von Claude, ChatGPT, Gemini oder Le Chat sind keine solchen Parser mehr. Sie sind laut aktuellem Überblick zur Mensch-Maschine-Interaktion ein Reasoning-Layer, der unvollständige, kontextuelle Sätze versteht und auf Absicht reagiert, nicht auf Schlüsselwörter. Erst durch diese Fähigkeit wird Sprache tatsächlich zur neuen Benutzerschnittstelle. Ein Klick sagt dem Computer „öffne das“. Ein Satz an ein Sprachmodell dagegen „buche mir die Reise per Bahn nach Berlin inklusive Hotel in meiner Kategorie zwischen dem 17. und 20. Mai“.

Andrej Karpathy, eine der einflussreichsten Stimmen der KI-Szene, zieht die Parallele zur Einführung der grafischen Benutzeroberfläche in den 1980ern. Damals ersetzten die Icons von Windows die Kommandozeile. Heute ersetzt die Beschreibung das Icon. Wer in Zukunft produktiv arbeiten will, beschreibt — und die Maschine baut oder führt Dinge autonom aus.

Im privaten Alltag: Sprache macht aus dem Smartphone einen Mitarbeiter

Auch privat wird sich grundlegend ändern, wie wir unser Smartphone oder die Geräte im Smart Home bedienen und nutzen. Das ewig nicht eingelöste Versprechen, das Apple 2011 mit Siri gegeben hat — dein Telefon versteht dich und hilft dir — wird jetzt eingelöst, nur von anderen Anbietern und in einer anderen Dimension.

Statt auf Programmsymbole zu klicken oder zu „touchen“, sprechen wir künftig mit unserem Smartphone. Genauer: Wir sprechen mit den dort installierten Large Language Models wie ChatGPT in ganzen Sätzen und sagen, was wir wollen. Zurück bekommen wir nicht eine Ergebnisliste mit Links, sondern stattdessen das Ergebnis. Einen Reiseplan. Eine gegengelesene E-Mail. Vielleicht künftig die Einkaufsliste basierend auf dem Foto meines leeren Kühlschranks. Eine Präsentation für die Jahreshauptversammlung meines Vereins über den neuen Grill. Eine E-Mail, mit der ich meine Freunde zu meiner Geburtstagsfeier einlade — genau in meinem Ton, da ich dem System meine alten Texte und E-Mails zum Lesen gegeben habe.

Das ist keine Zukunftsmusik mehr. Früher musste ich wissen, welche App ich öffne, welchen Button ich drücke, wo ich den Befehl im Menü finde. Künftig reicht die Beschreibung dessen, was ich erreichen will. Welches Programm im Hintergrund benutzt wird, das erledigt die Künstliche Intelligenz. Das ist — nach Tastatur, Maus, Touch — tatsächlich die nächste Stufe der Bedienung, die ich 2011 vorhergesagt habe. Mit fünfzehn Jahren Verspätung und von anderen Anbietern erfüllt, als ich damals vermutete.

Der Preis der Bequemlichkeit: Hirn einschalten, Kontrolle behalten

In natürlicher Sprache formulierte Sätze, egal ob getippt oder gesprochen, sind also das neue Interface. Das ist ungemein komfortabel. Ich beschreibe in meinen eigenen Worten, was ich brauche, und bekomme ein Ergebnis. Oft verblüffend gut. Manchmal beeindruckend. Und nicht selten einfach falsch.

Wenn ich heute in Google suche, bekomme ich nicht mehr nur Links, sondern eine Zusammenfassung in natürlicher Sprache. Ingrid Brodnig hat das gerade einmal für die Google-KI-Übersichten vorgerechnet: Selbst wenn neun von zehn Antworten stimmen — bei über fünf Billionen Google-Suchanfragen pro Jahr bedeutet die verbleibende Fehlerquote zig Millionen falscher Antworten pro Stunde. Und eine EBU-Studie der öffentlich-rechtlichen Rundfunkanstalten fand sogar in 45 Prozent der geprüften KI-Antworten mindestens einen erheblichen Fehler. Besonders gemein: Die Modelle formulieren gerade dann am selbstbewusstesten, wenn sie sich irren — also falsche Aussagen treffen.

Je bequemer es wird, desto größer die Versuchung, Kontrolle abzugeben, weil es dann ja so einfach ist. Dabei geht es nicht nur darum, Fakten und Quellen zu prüfen, auf deren Basis uns die KI antwortet. Es geht auch wieder einmal um unsere eigenen Daten. Wer einer KI einmal Zugriff auf E-Mails, Kalender, Dateien, Browser-Verlauf gibt, damit der KI-Agent „alles einfacher macht“, öffnet ein Tor, das sich schwer wieder schließen lässt. Und je weniger Mühe uns die Antwort kostet, desto weniger prüfen wir sie. Gerade bei vermeintlich trivialen Fragen — wann ist X gestorben, wie heißt das Gericht, wo liegt der Ort — scannen wir die Antwort nur noch.

Genau deshalb bleibt das eigene Hirn unersetzlich. Das eigene Misstrauen. Die eigene Kontrolle. Sprache als Interface ist ein Produktivitätsgeschenk — aber nur, wenn ich die Fähigkeit behalte, zu prüfen und zu widersprechen. Dem Modell. Dem Ergebnis. Und manchmal auch der Bequemlichkeit, mit der es mir serviert wird.

Im Unternehmen: Beschreibung ersetzt Bedienung — und das bricht Hierarchien auf

Auch im Beruf wird der Effekt deutlich zu spüren sein. Industrie-Prognosen rechnen damit, dass natürliche Sprache bis 2026 zur Standard-Schnittstelle für Unternehmensdaten-Workloads wird. Wer eine Auswertung, eine Präsentation, einen Prototyp braucht, öffnet kein Tool mehr. Er oder sie beschreibt, was gebraucht wird. Code, Dokumente, Designs, Analysen — alles entsteht aus dem gleichen Input: Sprache.

Die Folgen sind handfest. Die Grenze zwischen Anwendern und System-Designerin oder -Designer löst sich auf. Wer früher auf die IT-Abteilung warten musste, lässt sich heute das Dashboard von Claude bauen. Wer früher ein Agenturbriefing schreiben musste, kann sich heute von der KI ein Mockup in zwanzig Minuten erstellen lassen.

Das klingt komfortabel — aber es trifft unweigerlich den Mittelbau vieler Wissensberufe: Leute, die Geld damit verdient haben, Templates umzufärben, PowerPoints zu schubsen, Standardcode zu schreiben, Standardtexte zu redigieren. Dieser Mittelbau wackelt. Warten wir mal ab, ob sich das Versprechen bewahrheitet, mit der neuen KI-Arbeitsweise in zwei Jahren das Dreifache bei gleicher Teamgröße zu schaffen.

Der nächste Schritt: Die KI übernimmt den Rechner

Und weil die Entwicklung gerade erst richtig Fahrt aufnimmt, folgt die nächste Stufe auf dem Fuß. Sprache bleibt nicht im Chat-Fenster. Sie wandert in den Rechner selbst. Was der Business Punk in den letzten Tagen als „KI-Krieg ums Desktop-Monopol“ beschreibt, ist der konsequente nächste Schritt: Google liefert uns jetzt mit Gemma 4 eine KI, die autonom auf unserem Rechner läuft — erst einmal ohne Verbindung zu den „großen“ Large Language Models von Google. Diese lokal auf meinem Mac laufende KI kann wohl alles, was man so privat braucht — und ist kostenlos. Das Prinzip ist alt: Wir füttern Kundinnen und Kunden an und verdienen dann an allem drum herum.

Doch natürlich gibt es gute Gründe dafür, ein Large Language Model lokal laufen zu lassen. Das ist einmal der Datenschutz, denn viele Daten wandern einfach nicht in die Cloud der großen Tech Bros. Mit der lokalen KI ist man unabhängiger und es kostet weniger als die Abos von Gemini oder anderen Tools. Last but not least verbraucht man keine Energie in Rechenzentren, da alles lokal auf dem Rechner läuft.

Die KI Gemma 4 von Google läuft auf unserem Rechner daheim. Andere Anbieter wie Anthropic mit Claude Cowork, OpenAI oder Perplexity bieten Tools an, die auch lokal laufen, aber eben kontinuierlich mit den KI-Modellen der Anbieter in der Cloud kommunizieren. OpenAI hat Codex mit einer Funktion namens „Background Computer Use“ ausgestattet — die KI klickt, tippt, steuert Apps parallel zur eigenen Arbeit, plant sich Aufgaben über Tage oder Wochen selbst.

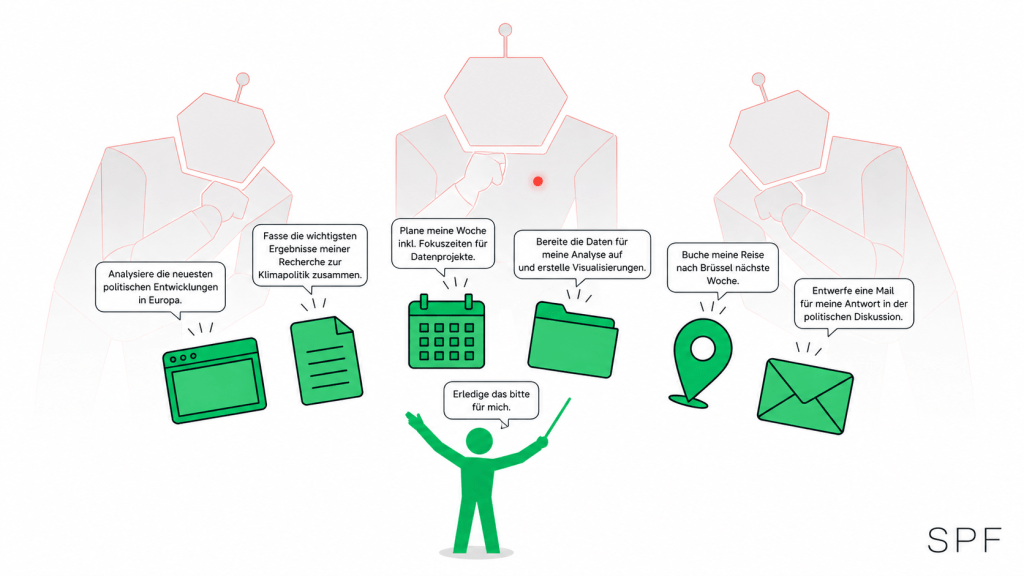

Oder aber Claude Cowork von Anthropic, das in der Lage ist, meinen Mac komplett selbständig zu bedienen. Wir sprechen mit dem Computer oder geben per Tastatur unsere Anweisungen ein, die KI arbeitet diese ab und steuert meinen Rechner. Ich sage nicht mehr nur einfach „Claude, schreib mir einen Text“ — sondern „Claude, geh in meine Ablage, sortiere den Quartalsreport, bau daraus die Präsentation für Donnerstag, und schick sie vorab an das Team“. Dies hat eine ganz andere Qualität.

Was heute noch holprig funktioniert, wird laut vieler Prognosen in zwei Jahren Standard sein. Damit einher geht, dass ich potenziell den letzten privaten digitalen Rückzugswinkel, die Kontrolle über meinen Computer und die darauf befindlichen Daten verlieren könnte. Wer den Sprach-Layer auf meinem Rechner kontrolliert, könnte alles sehen, was dort passiert und gespeichert ist. Jede Datei. Jede Mail. Jedes offene Fenster. Das macht die aktuelle Debatte um „Agentic AI“ und wie viele Rechte ich der KI gebe so zentral. Wieder einmal stellt sich die Frage, wie viel Bequemlichkeit man will und wie viel man von seiner Privatsphäre bereit ist, dafür abzugeben.

Das bequeme, ach so indiskrete Helferlein?

Natürlich ist das auch komfortabel, aber der Preis bei Siri und Alexa hieß: „Amazon owns my Echo; I’m just feeding it.“ Das trojanische Pferd steht nicht mehr nur im Wohnzimmer, es läuft demnächst ständig im Hintergrund auf unseren Notebooks, Smartphones und iPads mit und sieht alle unsere Daten. Und wieder einmal sind es fast ausschließlich US-amerikanische Konzerne, Google, OpenAI, Microsoft oder Anthropic, die davon profitieren. Das kleine gallische Dorf, Mistral aus Frankreich, versucht sich zu behaupten, hat es aber schwer. Und ob der neue deutsch-kanadische Zusammenschluss, besser die Übernahme von Aleph Alpha durch Cohere, mehr Souveränität für europäische Nutzer bedeutet, bleibt abzuwarten.

Sprache wird sich als neue Benutzeroberfläche durchsetzen und das ergibt absolut Sinn. Doch in der Kombination mit den Large Language Models und KI-Agenten entstehen neue Risiken, deren man sich bewusst sein sollte. Meine Befürchtung ist, dass sich viele Privatanwender darüber keine Gedanken machen werden und ihre Daten (Bank, Kreditkarte, Pass, Steuer, Sozialversicherung oder Gesundheitsdaten) freiwillig zur Verfügung stellen werden — weil es die Kombination von Sprache und KI so einfach macht, lästige Arbeiten durch die KI-Agenten erledigen zu lassen.

Für uns in Europa heißt das konkret: Wenn Sprache die Universalsprache zur Steuerung unserer Rechner wird — und die Modelle dahinter allesamt in Kalifornien, Seattle oder New York stehen und sich gleichzeitig in unsere Betriebssysteme einnisten — dann wird es eng mit unserer digitalen Souveränität. Noch sehe ich keine europäische Alternative. Vielmehr nistet sich bald die Google-KI Gemini auf meinem iPhone ein, sodass mich Siri trotz meines hessischen Slangs endlich versteht. Aber keine Sorge: Es wird ja alles ganz privat in den Apple-Rechenzentren gespeichert.

Kommentar verfassen